Color digital

En esta página iré dejando recursos para completar mis artículos sobre Color digital publicados en la revista Camera and light. Podréis encontrar versiones de mayor calidad de las imágenes que empleo de ejemplo, explicaciones más detalladas sobre el procesado de cada imagen y una lista de enlaces que he usado para informarme o que simplemente considero de interés.

Daniel Siragusano Additive Mixture – Un vídeo muy útil sobre el significado de “scene referred” y los problemas de aplicar transformaciones de entrada no lineales al material de cámara.

Yedlin.net – Todo lo que hay en esta página es oro y Steve Yedlin tiene una habilidad envidiable para dar con la forma más precisa y sencilla posible de explicar cualquier concepto.

Arri Technical Downloads – Hay que bucear un poco pero se puede encontrar una gran cantidad de información aquí, especialmente en los documentos de technical information y en los white papers.

Filmlight tutorials – Las charlas de Daniel Siragusano son muy interesantes especialmente como introducción al mundo de la gestión de color, aunque hay que tener en cuenta que está presentando y vendiendo un producto de la compañía en la que trabaja.

Mythbusting: Colour, Camera, Cinema – Este seminario del pasado Camerimage 2024 impartido por Dick Meier, Charles Poynton y Andrew Stockman merece la pena de principio a fin.

Charles Poynton Color FAQ – Poynton es una eminencia en este tema.

Hitchhicker’s guide to digital colour – Esta página web es una maravilla para encontrar definiciones de conceptos básicos del color digital explicadas de forma muy asequible.

Commission Internationale de l’Eclairage (CIE) – Sí, la gente que le dio nombre al modelo que empleamos para representar la percepción humana del color tiene una web con un glosario. Esto ya es un nivel bien friki.

Unión internacional de comunicaciones (UIT, más conocida por su acrónimo inglés: ITU) – Esta gente, entre otras cosas, es la que publica las recomendaciones para estandarizar la forma en la que nuestras pantallas decodifican el color y así tratar de asegurar que las imágenes que generamos se vean de forma consistente en distintos lugares. Es muy nutritivo ir directamente a la fuente de términos como Rec.709 para darse cuenta de que no está bien usado y que en realidad nos referimos a la BT.1886 (o Rec.1886).

Team Deakins Podcast con Joachim Zell – Joaquim Zell ha trabajado como científico de color en muchos proyectos con Roger Deakins y James Ellis Deakins, creando sus flujos de color y transformaciones de color personalizadas. Es una pasada escucharle hablar de cómo se generan transformaciones de color de cero para proyectos concretos o cómo gestionan el color cuando trabajan con VFX.

Team Deakins Podcast con Beverly Wood – Es súper interesante escuchar hablar a Beverly Wood sobre el fotoquímico y la transición al digital ya que fue un miembro activo en este cambio. Además, da una perspectiva que refuerza la idea de que el fotoquímico no es un look concreto y que el estilo final de la película se va a definir en mucha mayor medida por el procesado que hagas a posterior.

Color and mastering for digital cinema (Glenn Kennel, 2006) – El currículum de Glenn Kennel es muy amplio. Basta decir que durante sus años trabajando en Kodak dirigió el desarrollo del escáner Cineon y que posteriormente fue uno de los implicados en el desarrollo de las especificaciones para cine digital de DCI. Esto último es lo que cuenta en este libro, lo cual da una gran perspectiva de los razonamientos que hay detrás de conceptos como la resolución, la profundidad de bits, la función de transferencia, etc.

White papers de Tamara Seybold – Seybold trabaja en el departamento técnico de Arri desarrollando principalmente algoritmos de procesado en cámara (métodos de reducción de ruido entre otros). Durante los últimos años nos ha dejado auténticas joyas como su tesis doctoral sobre reducción de ruido. Aunque este tema tan concreto pueda no ser del interés de todo el mundo, su descripción del procesado de imagen que se da en una cámara desde la captación de la luz es muy útil y es lo que ha inspirado gran parte de mi segundo artículo de esta serie. A parte de la tesis, recomiendo Beyond the Kodak Image Set: A new reference set for color image secuences (Seybold, Goldstone y Andriani; 2010), en este documento se especifica el proceso de color que sufre la información capturada por el sensor en una Arri Alexa.

Charles Poynton Guided Tour of Color Space – Nadie mejor que Charles Poynton para expandir lo explicado sobre espacios de color y su relación con la sensibilidad espectral y la percepción humana.

Introducción al color digital 1 (C&L 135)

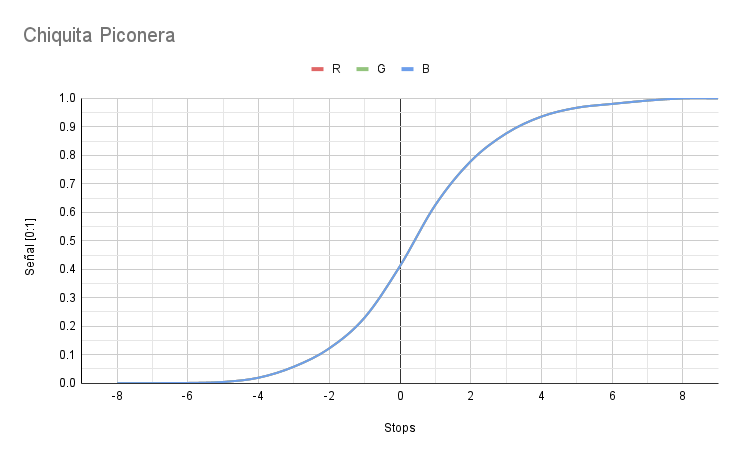

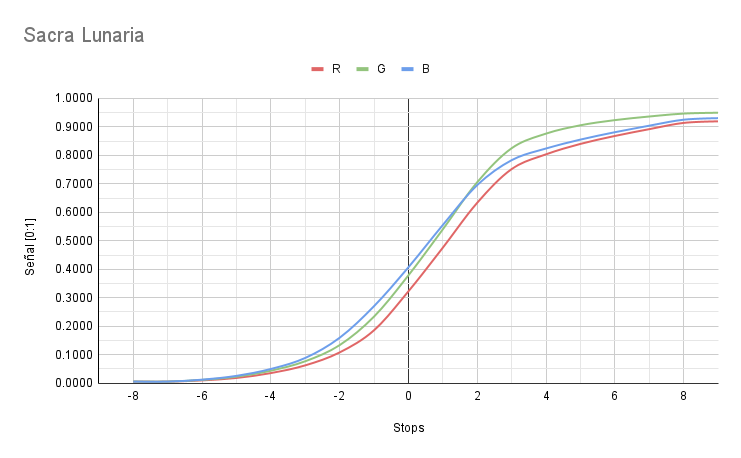

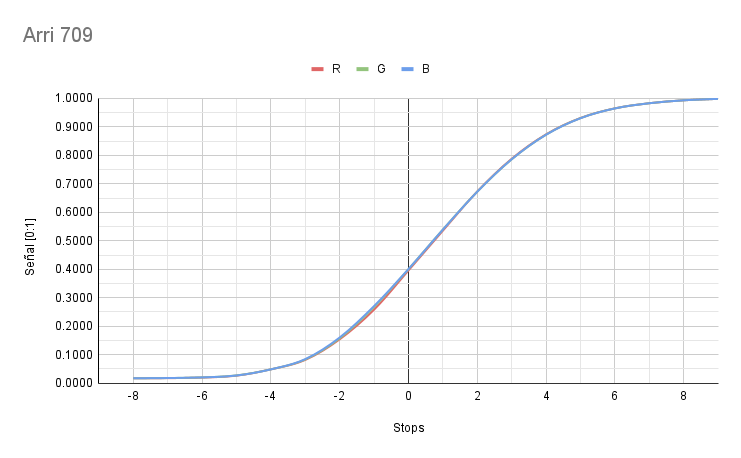

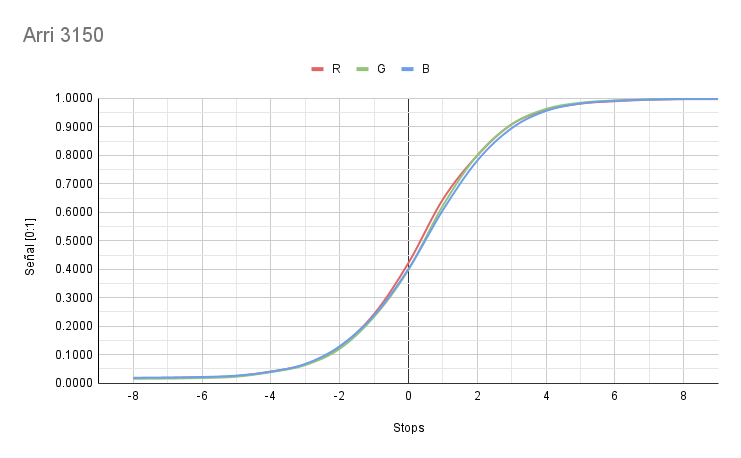

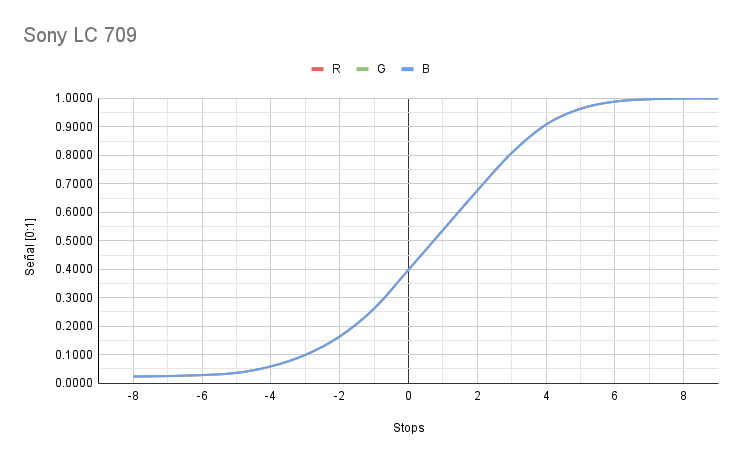

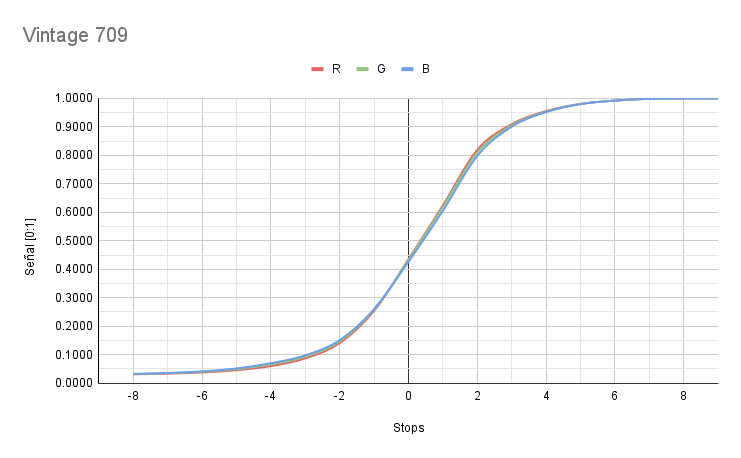

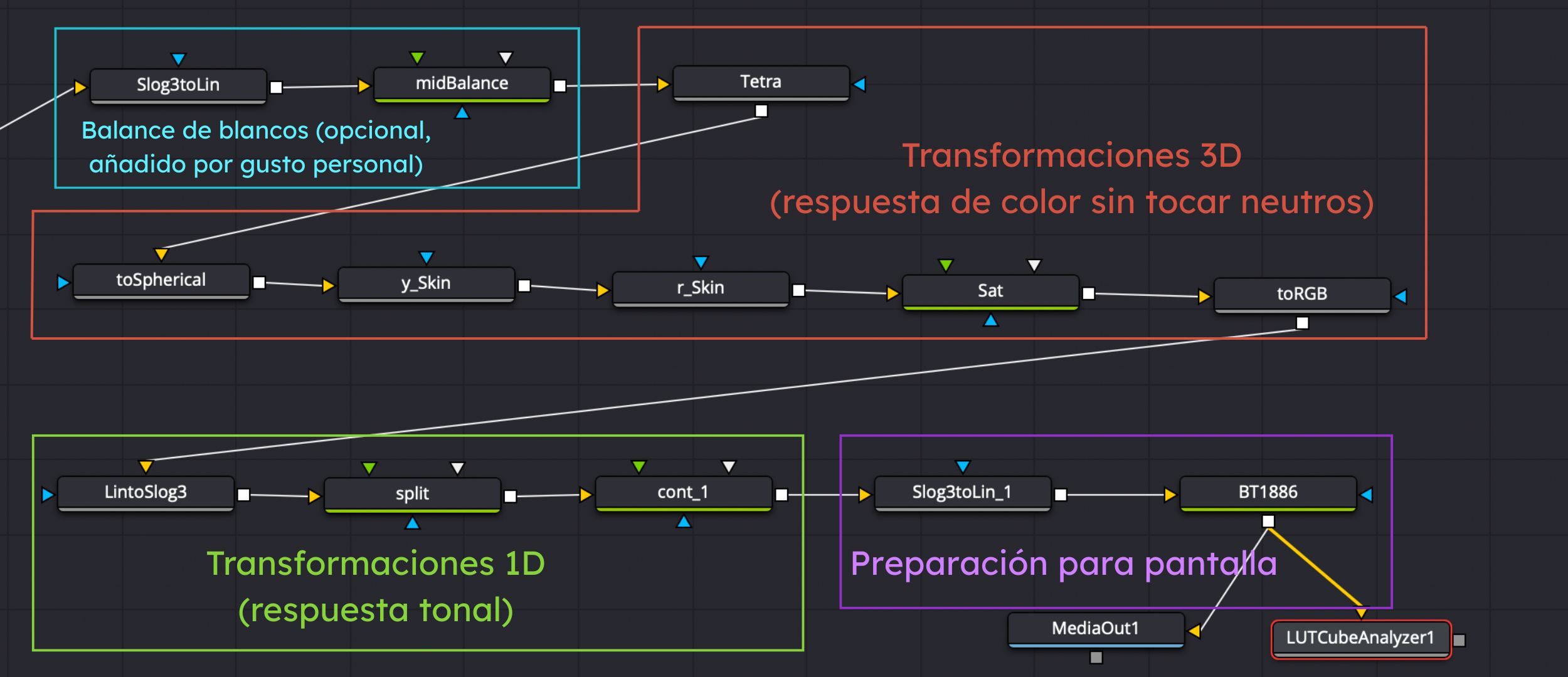

Gráficas con las curvas de contraste de distintas transformaciones de color. El eje horizontal muestra los pasos respecto al gris medio y el vertical la señal correspondiente a cada uno tras aplicar la transformación a la señal de entrada (la cual será, en el caso de Arri, LogC3 o Logc4; y en el caso de de Sony, S-Log3. Al lado, fotogramas de Chiquita Piconera (2024) y Sacra Lunaria (2025) con la respectiva LUT (para las LUTs de Sony, se ha llevado a cabo una transformación nominal a S.gamut3.cine/Slog-3. Digo nominal porque la transformación es solo entre los dos espacios de color sin tener en cuenta la respuesta específica del sensor de la cámara. Todo esto se explicará en el siguiente artículo.

Algo que me faltó aclarar en el artículo es que los ejemplos de Sacra Lunaria, al estar en color, presentan diferencias más allá de las curvas de contraste. Como vimos, las curvas son la parte unidimensional de la transformación, pero la respuesta de color incluye también transformaciones tridimensionales que, sin afectar necesariamente a estas curvas, cambian cómo se muestra el color de la imagen. Es gracias a esta parte de la transformación que podemos tener tonos de piel más o menos matizados y diferencias sutiles que cambian de una forma compleja la apariencia de la imagen.

Transformaciones personalizadas – Para Chiquita Piconera diseñé una curva muy contrastada para conseguir un blanco y negro muy duro, esta es la transformación más contrastada de todas las que muestro. En el caso de Sacra Lunaria empleé mi LUT personal con la transformación que suelo usar en todos mis trabajos, pero escribí una pequeña DCTL para modificar el contraste de una manera específica y bajarlo un poco, ya que la mayor parte del corto se desarrollaría en niveles muy bajos de luz y quería recuperar algo de detalle en las sombras.

Arri 709 – Esta transformación está claramente diseñada para no llevar la imagen a lugares muy extremos y dar una gran flexibilidad (de hecho, la idea es que sirva como base para crear el look con sus LUTs log to log). Aún así, han hecho que el canal rojo baje más que el resto en los dos pasos anteriores al gris medio dando un matiz azulado a las sombras.

Arri 3150 – Esta transformación pretende emular un bleach bypass y es por lo tanto significativamente más contrastada que la anterior. Aún así, es curioso cómo hay poca diferencia entre canales excepto por un pequeño realce de los rojos en la zona en los medios tonos. Esta transformación es en realidad una mezcla de dos: la 3150 aporta el estilo creativo pero mantiene la salida en LogC4 esperando a ser convertida al espacio de color de la pantalla (en este caso BT.1886) por la Arri 709.

Sony LC709 – Muy parecida a la de Arri ya que cumplen el mismo propósito. Esta, de hecho se mantiene completamente neutra.

Sony Vintage709 – En este caso, la LUT es bastante contrastada pero tiene unos negros más lavados. Esta transformación se anuncia en la web de Sony como hecha específicamente para la Burano, por lo que, al no haber igualado la respuesta del sensor de la Alexa con la que se rodaron estos cortos a la de la Burano, es posible que haya variaciones en la respuesta de color final.

Introducción al color digital 2: la cámara y las transformaciones de color (C&L 136)

*Todas las transformaciones de igualado utilizadas en este artículo son versiones iniciales. Va a haber diferencias claras entre frames, sobre todo los que involucran pantallas led como es el caso de las primeras cinco imágenes. Estos ejemplos deberían ser interpretados teniendo en cuenta dos cosas:

- Estas transformaciones se han realizado de forma rápida y provisional para poder emplear ejemplos en este artículo. Aún queda mucho trabajo de probar y trucar parámetros del algoritmo utilizado (así como de probar otros algoritmos) hasta dar con la receta óptima. Este proceso será descrito en el siguiente artículo, con resultados más definitivos.

- Debido a diferencias intrínsecas debidas a la sensibilidad espectral de distintas cámaras, siempre va a haber colores que no sean igualables. Mi hipótesis es que en la mayoría de los casos en los que este problema aparezca, será de forma tan concreta y sutil que resultará anecdótico y no condicionará nuestra percepción general del look. De todas formas, cada lector decidirá dónde coloca el listón de lo que considera aceptable.

Estas imágenes han sido capturadas con una Red Komodo-X, Sony FX6, Sony Venice 2, Arri Alexa Mini y Arri Alexa 35. En mi opinión, las diferencias obtenidas con la transformación provisional están tan localizadas que no me hacen considerar que haya una diferencia importante de look entre las distintas cámaras. Además, como digo, rodar una pantalla LED es posiblemente uno de los mayores retos a los que nos podemos enfrentar a la hora de tratar de igualar distintos sensores.

Es evidente que, a pesar de ser similares, las imágenes capturadas por dos cámaras del mismo fabricante y codificadas en el mismo espacio de color de escena (que al ser de escena debería estar relacionado de forma directa e inequívoca con los colores reales capturados) no dan una reproducción igual del color.

Esta imagen se ha convertido al espacio de color de pantalla (BT.1886) de la manera más objetiva posible. Podemos ver cómo, a parte de no tener especial interés en la reproducción del color y el contraste, tiene una transición al blanco abrupta y estéticamente fea que además nos hace perder detalles que fueron capturados por el sensor.

Podemos ver cómo emplear una transformación que solo convierte entre especificaciones de espacios de color no iguala la respuesta de dos cámaras excepto en el contraste.

Apunte sobre BT.1886, Rec.709 y sRGB: durante el artículo uso de ejemplo de espacio de color de pantalla el BT.1886 porque a día de hoy sigue siendo el más extendido. Es el espacio de color empleado para transmisión de imagen HD en la televisión y, aunque tiene ya muchos años, es aún muy vigente. Suele haber mucha confusión porque la gente suele llamarlo Rec.709. En la recomendación BT.709 se establecen los primarios y el blanco de referencia pero no se indica ninguna función de transferencia ya que es un espacio diseñado para cámaras y dejan esto a elección del fabricante. La BT.1886 emplea los primarios y el blanco especificados en la BT.709, pero añade la función de transferencia con el exponente de 1/2.4 que sí que define completamente el espacio de color de nuestras pantallas.

El sRGB emplea también esos mismos primarios y blanco, pero la función de transferencia emplea un exponente de 1/2.2. Las imágenes que entrego para la versión impresa están codificadas en sRGB, mientras que las originales (subidas en esta sección web) están codificadas en BT.1886.

Introducción al color digital 3: pruebas para el igualado y evaluación de cámaras (C&L 137)

ALGUNOS FACTORES A TENER EN CUENTA AL DISEÑAR PRUEBAS PARA IGUALAR CÁMARAS

- Necesitamos suficientes muestras para una caracterización efectiva.

- Cuanto más uniformemente espaciadas estén las muestras entre sí, más efectiva será la interpolación.

- Unas condiciones no controladas pueden introducir “ruido” (variaciones aleatorias en las muestras, no el ruido visual de las cámaras) que condicione el resultado. Cuando la forma de adquirir las muestras es muy susceptible a errores humanos (tener que cambiar manualmente el diafragma, mover luces de sitio…), más muestras aumenta las posibilidades de ruido.

- La luz utilizada. Desde errores de metamerismo por la reproducción cromática del LED hasta el desgaste de gelatinas o de las propias lámparas de incandescencia.

- Repetibilidad. Si nuestra idea es tener muestras de una o varias cámaras con la posibilidad de igualarlas a otras en el futuro, tendremos que ser capaces de recrear las condiciones exactas en las que adquirimos las primeras. Esto es muy difícil de conseguir si no es con máquinas programadas con tal propósito y una comprobación rigurosa del desgaste de los elementos utilizados.

- El ruido de las cámaras. Siempre va a haber variaciones entre píxeles debido al ruido, y estas serán más notables en las muestras con poca luz. Debemos tener esto en cuenta y podemos emplear herramientas que hagan la media de varios píxeles dentro de un mismo color para sacar muestras lo más representativas posible.

Tenemos que tener en cuenta estos factores para tomar las mejores decisiones posibles. Es muy difícil hacer unas pruebas perfectas, pero es factible hacerlas adecuadas a unos propósitos y recursos dados.

Definir el radio de la interpolación RBF

Cuando tenemos registrados unos colores de la cámara A que tienen que convertirse en otros colores concretos de la cámara B, para estos no hay ninguna duda, hay una correspondencia unívoca. Sin embargo, se requiere una función de interpolación para, utilizando estas referencias, inferir una regla general que permita transformar un color arbitrario de la cámara A a su correspondiente en la cámara B.

Dado un color de la cámara A que no pertenezca a la tabla de referencia, la función de interpolación lo transforma al espacio de color de la cámara B observando cómo se transforman las referencias más cercanas al mismo en el espacio de color de partida. En este sentido, cada color de referencia influye sobre el cálculo de la función de interpolación en su vecindad. El radio define la extensión del área de influencia de cada color de referencia. Por ejemplo, si el radio es muy grande, el color rojo podrá influir en los magentas aunque ya tengamos otra muestra conocida más cercana a estos.

En un caso ideal, el radio tendría que ser de la distancia a la que están los colores recogidos, asumiendo que estos estuvieran distribuidos uniformemente.

Si tenemos muchas muestras muy espaciadas entre sí necesitamos que el radio sea grande para cubrir esos grandes huecos sin puntos de referencia. Si tenemos unas muestras muy cercanas, el radio deberá ser más pequeño para que no se influyan entre sí.

Por este motivo, el uso de radios grandes proporcionaba resultados perceptualmente buenos en los planos de prueba mientras que las cartas de color no se igualaban: los efectos solapados de los colores de referencia causaban ruido e impedían fijar la transformación de los mismos. En el extremo contrario, el uso de radios pequeños permitía igualar las cartas a la perfección, pero proporcionaba resultados insatisfactorios en planos reales. Incluso, cuando el radio se reducía tanto que la función de interpolación sólo podía deducir los colores más cercanos a los de referencia, se llegaba a producir banding.

Cuando los colores de referencia siguen una distribución no uniforme, como es nuestro caso, se debe establecer un radio de interpolación que proporcione un equilibrio entre precisión y satisfacción perceptual.

ORDEN DE OPERACIONES: CURVAS 1D, MATRICES E INTERPOLACIÓN

El proceso seguido para obtener las transformaciones que tratamos en el artículo es, en resumen, primero realizar el igualado en 1D y después aplicar la interpolación 3D. ¿Por qué estas operaciones y por qué este orden?

Si cojo las muestras tal y como salieron de cámara y las meto en el programa de interpolación RBF sin haberlas igualado antes en su función de transferencia ni WB, este me puede dar unos buenos resultados. Sin embargo, en su momento hice algunas pruebas comparativas y vi que añadir antes el paso del igualado 1D ayudaba a conseguir resultados ligeramente mejores. Además, me gusta la idea de hacer el sistema un poco más modular. Por otra parte, creo que si hacemos antes todo lo posible por dejar las muestras lo más parecidas entre sí con operaciones simples, la interpolación 3D tendrá que centrarse solo en la parte más compleja.

Hay un paso intermedio que no he añadido para las pruebas publicadas: una matriz 3×3. Una matriz es una operación lineal que se emplea en las transformaciones de espacio de color, pero para igualar cámaras se queda corta puesto que muchas veces las diferencias entre estas son no-lineales. Sin embargo, esto no quiere decir que no pueda dar resultados bastante buenos para según qué aplicaciones, especialmente en el caso de los sensores digitales, que una vez en espacio lineal, operan de una forma muy similar.

En un intercambio de mails con Joseph Slomka (científico de color principal de Fotokem que ha trabajado en producciones como Dune, The Batman, The Creator, Oppenheimer y un largo etcétera), fue tan amable de compartir conmigo algunas de las claves aquí escritas. Me gustaría dejar un resumen:

- Al trabajar para producciones concretas, el igualado genérico entre cámaras es solo el punto de partida. Los igualados más específicos de planos concretos son obtenidos usando el pipeline y shot design de la película. Los casos más problemáticos pueden ser atacados con soluciones únicas y personalizadas.

- No es lo mismo tratar de igualar cámaras digitales entre sí que cámaras digitales a sistemas fotoquímicos. Los sistemas fotoquímicos son muy diferentes a los digitales y la interpolación 3D es muy adecuada para este proceso.

- En el caso de su trabajo en Dune [hacer un film-out para conseguir los atributos espaciales del fotoquímico manteniendo la respuesta de color original], el negativo utilizado fue un negativo de laboratorio que se comporta de forma lineal, a diferencia del negativo de cámara.

- La señal obtenida de una cámara digital no es perfectamente lineal, pero sí muy aproximada. Es por esto que una matriz 3×3 en espacio lineal debería dar un resultado bastante decente. Si, después de eso, se aplica una interpolación 3D para que se ocupe de los matices más sutiles, debería conseguir un muy buen resultado.

Con esta información, me gustaría hacer la prueba y añadir el paso intermedio de la matriz una vez las muestras estén linealizadas. Cuando tenga tiempo, convertiré esto en una sección a parte dentro de la web.

MATRICES DIFERENTES SEGÚN EL BALANCE DE BLANCOS

En el artículo 2 de la serie vimos cómo la corrección de ganancias para el WB se aplica antes de la debayerización y por lo tanto antes también de la matriz que lleva la señal del RGB nativo de cámara al espacio de color en uso. Si bien es cierto que, al aplicar ganancia a nuestro material en estado lineal podemos modificar el balance de blancos de manera muy precisa y natural, me gustaría matizar lo siguiente, ya que tiene que ver con estas pruebas y los resultados que podemos esperar:

Antes de iniciar las pruebas sabía que Arri empleaba matrices distintas de RGB nativo a AWG3 según el balance de blancos seleccionado. El propósito de esto es potenciar los tonos cálidos al rodar en 3200ºK (sin cambiar la dominante de los neutros) y que no sea exactamente igual rodar con una fuente de cualquier temperatura teniendo la cámara perfectamente balanceada. Por este motivo, todas las muestras empleadas para las transformaciones y todos los planos de referencia están revelados a 3200ºK y la corrección de dominantes está aplicada después del igualado (por supuesto, el mismo ajuste exacto en cada una).

Solo tenía confirmación de que esto pasaba en LogC3/AWG3, pero no sabía si era algo que Arri seguía haciendo en Reveal y tampoco sí el resto de fabricantes llevaban a cabo prácticas similares. Para comprobarlo, seleccioné planos de la Colorchecker de cada cámara y los dupliqué, revelando uno a 3200ºK y otro a 5600ºK, después, los igualé mediante ganancia lineal utilizando como referencia los parches grises. El resultado: todas las cámaras de empleadas en esta prueba emplean matrices distintas en función del balance de blancos.

En las siguientes imágenes tenéis un ejemplo de la diferencia que hay cuando al mismo plano se le aplica la misma ganancia pero uno cuenta con la matriz para 3200ºK y otro para 5600ºK. El proceso que he seguido para sacar estos planos ha sido:

- Revelar el plano con 5600ºK y con 3200ºK en LogC3/AWG3

- En Fusion, convertir de log a lineal.

- Aplicar a cada plano su correspondiente matriz de AWG3 a RGB nativo en función de su WB.

- Aplicar al plano revelado en 3200ºK una corrección de ganancia para igualar los grises al plano revelado en 5600ºK.

- Aplicar a cada plano su correspondiente matriz de RGB nativo a AWG3 en función de su WB.

- Aplicar LUT de visualización.

Si en el paso 5 aplico la misma matriz a ambos planos (da igual que sea la de 3200ºK o la de 5600ºK), ambos quedan completamente igualados, lo que prueba que su estado previo en RGB nativo es idéntico y las diferencias vienen de las matrices.

Hice esto con LogC3/AWG3 porque es el único sistema de color para el cual cuento con las matrices necesarias para pasar a RGB nativo, ya que es algo que los fabricantes no suelen publicar.

Conclusión: para un propósito general he aprendido que aplicar ganancia al material en estado lineal nunca me va a dar exactamente el mismo resultado que variando la temperatura en cámara, aunque la diferencia es tan sutil que solo se notaría en una comparación directa.

De cara al igualado, si mi transformación está hecha empleando muestras reveladas a 3200ºK el igualado no será tan preciso sobre material revelado a otras temperaturas. Aún así, la diferencia resultante sería sutil y no condicionaría enormemente el look.

La manera más precisa de hacer esto sería contar con las matrices para llevar todas las cámaras a su estado de RGB nativo y de ahí transformarlas a lo que quiera. Aún así, no sé si merece la pena tener que estar aplicando una transformación distinta cada vez que haya rodado con un WB diferente en un proyecto.

Para leer más sobre RGB nativo y matrices con dependencia del balance de blancos, podéis leer este estupendo hilo.

Transformación 1D aplicando curvas al material en estado lineal para igualar la escala de grises. En este caso se da la particularidad de que los parches de color quedan relativamente parecidos, podría darse la situación de que queden mucho más dispares ya que de momento solo hemos igualado la respuesta tonal.

Resultado final de la transformación en exterior.

Tened en cuenta que el sol se mueve entre planos y que hay un cambio notable en la iluminación en la cara. Por lo demás, el brillo especular en el parabrisas nos da una idea de la importancia (o no) de tener más o menos rango dinámico en estas situaciones (la latitud para exponer y tener margen en posproducción es otra historia). Estamos hablando de que la cámara con más rango dinámico de las pruebas en 800ISO tiene más de 8 pasos por encima del gris medio y la que menos tiene alrededor de 5,5.

Resultado final de la transformación en interior con pantalla LED.

En este caso se ve una gran diferencia de color , como era de esperar, en la pantalla LED, aunque las pieles tampoco terminan de estar bien afinadas.

Comparativa de rango dinámico con cámaras igualadas

Una vez igualadas, es más fácil hacer comparativas de atributos que no pueden ser manipulados, como el rango dinámico. Es importante señalar que los límites en el rango dinámico se hacen más o menos aparentes según el contraste de la transformación de salida utilizada y el contraste que emplee en las zonas altas y bajas de la curva de contraste.

*La calidad está comprometida por la compresión de vimeo, si alguien quiere analizar algo mejor este vídeo, puede escribirme para recibir una copia con menos pérdida.

Dado que no se recogieron muestras de colores extremos para realizar las transformaciones, el color de la luz roja no está determinado y por lo tanto no se ve en absoluto igual. Merece la pena comentar que, viendo el material en bruto, las únicas cámaras que recogieron la información completa sin artefactos visibles de esta luz directa fueron la Alexa 35, Sony Venice 2 y FX6 (esta última presentando artefactos de compresión que tal vez puedan ser evitados en una futura actualización que permita la grabación en un códec más robusto).

Introducción al color digital 4: creación de looks (C&L 138)

¿Es necesario hacer todo esto?

Pues no.

Como justifico en el artículo, esto es la forma larga, manual y complicada de hacerlo. Pero es la forma de tener control absoluto y, por lo tanto, aprender de verdad.

Lo bueno es que una vez entendemos este proceso podemos decidir qué partes dejamos en manos de otra gente. Por ejemplo, puedo partir de la transformación de la CST de DaVinci y aplicar antes ajustes sutiles de las curvas para llegar a un look que me guste, pero dejando que la gestión de color y el mapeo general de color lo haga una transformación predeterminada.

O puedo hacerlo todo manualmente pero dejar la preparación para pantalla en manos de la CST, que al fin y al cabo son operaciones matemáticas que no se basan en nada subjetivo (aunque en ese caso hay que desactivar un montón de opciones de la CST para que realmente se quede solo con lo objetivo).

Look creado para el artículo

Arri Film Lab Premiere

CST de DaVinci Resolve

Por supuesto, cada uno es libre de decidir qué respuesta de color prefiere (quizás juegue en mi contra el pequeño cambio de balance de blancos que he metido por defecto y que enfría ligeramente la imagen, pero esa es la cuestión, que es algo subjetivo). Pero, si la decisión entre el look hecho de cero y el generado con herramientas de Arri o DaVinci es solo de gustos, significa que el primero es, a priori, una opción igual de válida que el resto. Para una transformación hecha en un día con herramientas accesibles, esto es un gran resultado.

Sin embargo, quiero aprovechar este espacio para hablar de algunos de los defectos de la transformación lograda, ya que se ha hecho con tiempo limitado y tiene cosas a mejorar a pesar de ser, en general, bastante robusta:

- Se puede observar que sufre un poco en los colores primarios más saturados, la lámpara roja queda muy pálida. En el modelo de color esférico, al reducir los tramos altos de saturación, son afectados antes los colores primarios que los secundarios. Esto significa que para evitar clipeos desagradables en los secundarios, tuve que bajar la saturación mucho, afectando demasiado a los primarios. Es por esto que emplear la curva del canal de saturación en este modelo de color no es el mejor sistema para hacer un mapeo de gamut, si bien lo es para diseñar una respuesta de saturación bonita en los tramos medios.

- Por el mismo motivo, algunos magentas y amarillos muy extremos podrían resultar en clipeos bastante desagradables. En mis pruebas solo he encontrado este problema en colores generados sintéticamente, pero para terminar de tener una transformación fiable en todo tipo de ocasiones, sería conveniente solucionarlo (a veces pasarán a través de la transformación grafismos y materiales generados que pueden albergar colores muy extremos).

- Estos dos puntos podrían haberse prevenido empleando herramientas de gamut mapping. Y es lo que recomendaría hacer a cualquiera que necesitara sacar esta transformación urgentemente. En este caso y al ser para la revista, prefería ceñirme a herramientas completamente manuales en las que tuviera el control total de lo que estaba sucediendo (es decir, como no he diseñado el comportamiento del mapeo de gamut de DaVinci, no me permití usarlo).

- Tengo pendiente explorar formas de controlar la respuesta de los colores más extremos empleando interpolación RBF como la empleada en el matcheo de cámaras, pero es algo que aún no he podido probar.

Sobre la gestión de color

Estoy en ello, que no me da la vida. Antes de que acabe diciembre debería tener esto terminado.